Installer Open WebUI et Gemma4 sur Windows

L'IA pour les "nuls" (Le concept)

C'est quoi un "Modèle" d'IA ?

Imaginez un modèle d'IA comme un cerveau numérique compressé. Ce cerveau a lu des milliards de pages de texte et a appris à prédire le mot suivant de manière logique.

- En ligne (ChatGPT, Claude) : Vous envoyez votre question au serveur d'une entreprise, elle la traite et vous renvoie la réponse.

- En local (Open WebUI + Ollama) : Vous téléchargez ce "cerveau" sur votre disque dur et votre carte graphique le fait réfléchir.

Pourquoi choisir le Local plutôt que le Cloud ?

- Confidentialité totale : Vos fichiers de code, vos secrets industriels ou vos journaux intimes ne sortent jamais de votre PC.

- Gratuité illimitée : Pas d'abonnement à 20$/mois. Vous ne payez que l'électricité.

- Censure réduite : Les modèles locaux sont souvent moins bridés que les versions grand public en ligne.

- Disponibilité : Ça fonctionne même sans connexion internet.

Pourquoi Gemma 4 sur votre PC ?

Gemma 4 est la dernière génération de modèles "ouverts" de Google. Pour votre usage, c'est le compagnon idéal car :

- Optimisation NVIDIA : Elle utilise les nouveaux cœurs Tensor de votre série 40 pour une vitesse fulgurante.

- Multimodale : Elle peut analyser des captures d'écran de vos erreurs de code (modèles E2B/E4B).

- Fenêtre de contexte : Elle peut "garder en tête" jusqu'à 128 000 mots, idéal pour de longs scripts.

Choisir sa configuration

Le "poids" de l'IA se mesure en Paramètres (ex: 7B, 14B, 32B). Plus il y a de paramètres, plus l'IA est intelligente, mais plus elle demande de mémoire (VRAM) sur votre carte graphique.

Quel modèle Gemma 4 choisir pour votre PC ?

- Configuration Légère

- Matériel : PC de bureau classique (sans carte graphique dédiée), MacBook Air ou PC avec 8 Go de RAM.

- Modèle :

Gemma 4 - 2B - Usage idéal : Assistance textuelle ultra-rapide, correction de mails, résumés de textes et petits scripts Python simples.

- Configuration Standard

- Matériel : PC Gamer "Budget" ou portables créatifs (NVIDIA RTX 3050, 4050 avec 6 Go de VRAM).

- Modèle :

Gemma 4 - 7B - Usage idéal : Polyvalence totale. Très bon équilibre entre rédaction créative, logique de base et discussions fluides.

- Configuration Équilibrée

- Matériel : PC Gamer milieu de gamme (NVIDIA RTX 3060, 4060 avec 8 Go de VRAM).

- Modèle :

Gemma 4 - 9B - Usage idéal : Le "Sweet Spot". Très fluide pour le code complexe, les discussions longues et l'analyse de documents.

- Configuration Performance

- Matériel : PC Haute performance (NVIDIA RTX 3080, 4070, 4070 SUPER avec 10 à 12 Go de VRAM).

- Modèle :

Gemma 4 - 14B (Coder) - Usage idéal : Spécialiste du développement. Capacité de raisonnement avancée, architecture logicielle et débogage intensif.

- Configuration Expert

- Matériel : Station de travail ou PC de passionné (NVIDIA RTX 3090, 4090 avec 24 Go de VRAM).

- Modèle :

Gemma 4 - 27B - Usage idéal : Le summum du local. Analyse de données massives, compréhension de projets de code entiers et réflexion philosophique/logique profonde.

Le petit lexique

- VRAM (Mémoire Vidéo) : C'est le facteur limitant. Si vous essayez de faire tourner un modèle trop gros (ex: un 27B sur une carte de 6 Go), l'IA sera extrêmement lente car elle devra utiliser la mémoire de votre PC (RAM), qui est beaucoup moins rapide que celle du GPU.

- Le chiffre (2B, 9B, 27B) : Le "B" signifie Billions (milliards de paramètres). Plus le chiffre est haut, plus l'IA a de "neurones" et peut comprendre des concepts complexes.

- Version "Coder" : Certaines versions de Gemma 4 sont spécifiquement entraînées sur des dépôts GitHub. Elles sont plus performantes pour programmer mais parfois moins "littéraires" pour écrire un poème.

Tutoriel d'installation (Le pas à pas)

Étape 1 : Le moteur (Ollama)

Ollama est le logiciel qui "porte" l'IA. C'est le moteur sous le capot.

- Allez sur ollama.com et cliquez sur Download for Windows.

- Installez-le comme n'importe quel logiciel. Une petite icône d'alpaga apparaîtra près de l'horloge :

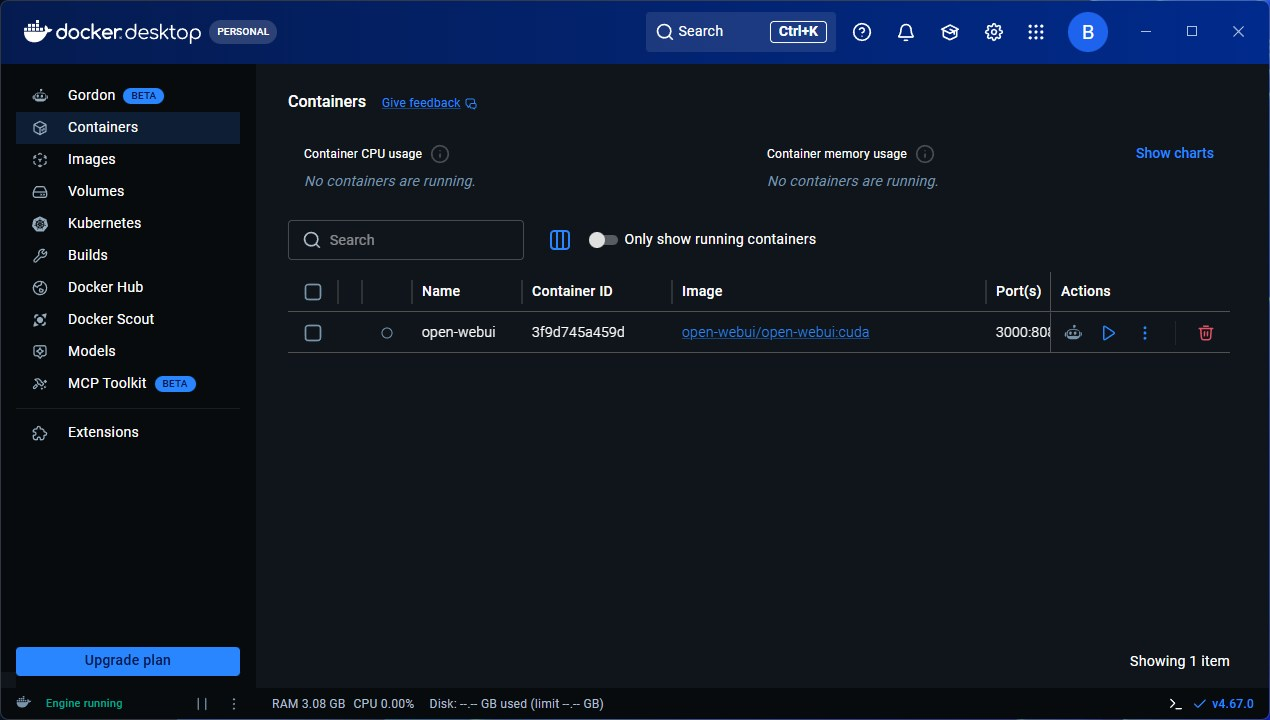

Étape 2 : Le garage (Docker Desktop)

Open WebUI est une application complexe qui a besoin de son propre environnement isolé pour fonctionner proprement. On utilise Docker.

- Téléchargez Docker Desktop.

- Pendant l'installation, si on vous demande d'installer WSL 2, dites OUI. C'est le moteur Linux de Windows qui rend tout cela rapide.

- Redémarrez votre PC. (Étape cruciale).

Étape 3 : L'interface (Open WebUI)

C'est ici que la magie opère. Nous allons dire à Docker de télécharger et lancer l'interface.

- Faites un clic droit sur le menu Démarrer et choisissez Terminal (ou PowerShell).

- Copiez et collez cette commande (optimisée pour votre GPU NVIDIA) :

docker run -d -p 3000:8080 --gpus all --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:cuda

Étape 4 : Premier lancement

- Attendez 2 minutes que Docker finisse le téléchargement.

- Ouvrez votre navigateur (Chrome, Edge...) et tapez :

http://localhost:3000. - Créez un compte. Note : Ce compte est local à votre machine, vous pouvez mettre ce que vous voulez.

Installer et lancer Gemma 4

Pour essayer Gemma 4, vous avez plusieurs options selon la puissance de votre machine. La commande run va automatiquement télécharger le modèle s'il n'est pas présent :

Pour la version haute performance (31B) :

ollama run gemma4:31bPour les appareils mobiles ou PC légers (E2B ou E4B) :

ollama run gemma4:e4b

Pour une version équilibrée (Standard) :

ollama run gemma4

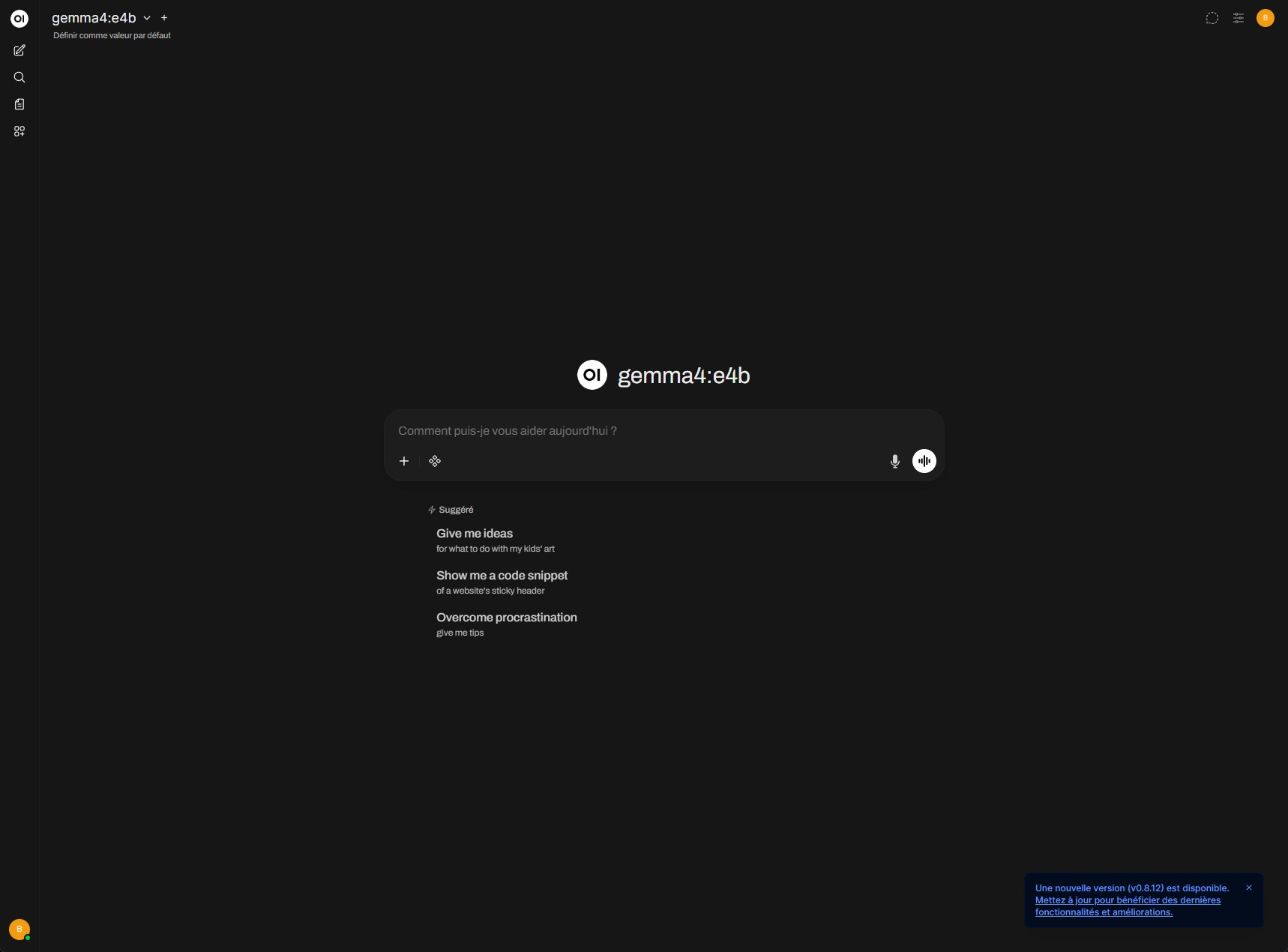

Et voilà :